Карпати перестал кодить и начал «компилировать знания» — разбираю его систему LLM Knowledge Bases

Андрей Карпати — сооснователь OpenAI и бывший глава ИИ в Tesla — опубликовал пост, который набрал 15 миллионов просмотров. Он перестал тратить токены на код и построил систему, где ИИ компилирует знания в структурированную вики. Разбираю, как это устроено и почему это меняет подход к работе с информацией.

Андрей Карпати — человек, который придумал термин «vibe coding» и руководил ИИ-направлением в Tesla — опубликовал пост, который за пару дней набрал больше 15 миллионов просмотров. Он написал, что всё меньше тратит токены на генерацию кода — и всё больше на то, чтобы ИИ «компилировал знания».

Звучит абстрактно? На самом деле за этим стоит конкретная система, которую можно собрать и использовать уже сейчас.

Но это ещё не всё. Пост стал настолько вирусным, что на следующий день Карпати опубликовал так называемый «idea file» — GitHub-гист с детальным описанием всей архитектуры. Не код. Не приложение. Структурированную идею, которую любой ИИ-агент может взять и реализовать под ваши нужды. Это сам по себе интересный сдвиг, но о нём — чуть позже.

Суть: ИИ больше не пишет код — он строит энциклопедию

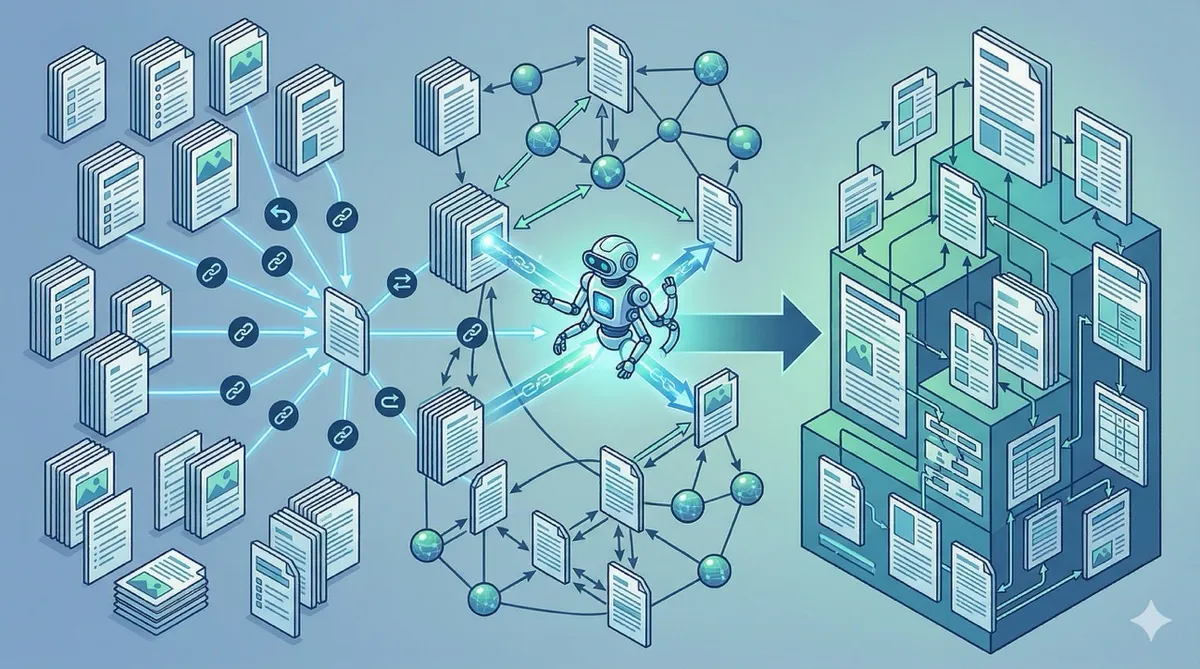

Карпати описал рабочий процесс, в котором LLM берёт сырые документы — статьи, научные работы, репозитории, датасеты, картинки — и превращает их в структурированную вики. Не просто конспект, а полноценную энциклопедию с перекрёстными ссылками, категориями и концептуальными статьями.

Его база по одной исследовательской теме выросла до 100 статей и 400 000 слов. И он почти не редактирует вики вручную — ИИ делает это сам.

Вот ключевая цитата: «Большая часть моих токенов теперь идёт не на манипуляцию кодом, а на манипуляцию знаниями».

Как устроена система: три слоя и шесть шагов

В idea-файле Карпати описал архитектуру подробнее, чем в оригинальном посте. Вся система стоит на трёх слоях:

- Raw Sources (

raw/) — неприкосновенная коллекция исходных документов. ИИ читает, но никогда не редактирует. Это ваш источник истины - Wiki (

wiki/) — структурированная вики из.md-файлов, которую ИИ пишет и поддерживает целиком. Вы читаете — он обновляет - Schema (

CLAUDE.mdилиAGENTS.md) — конфигурационный файл, который объясняет ИИ правила: структуру страниц, форматы frontmatter, воркфлоу загрузки и аудита. Без него ИИ — просто чат-бот с доступом к файлам. С ним — дисциплинированный хранитель знаний

Именно schema-файл — ключевой элемент, о котором мало кто говорит. Он работает как персистентная память между сессиями: агент каждый раз читает его и знает ваши соглашения, форматы страниц и рабочие процессы. Вы с ИИ постепенно дорабатываете schema вместе — и система становится всё точнее.

А дальше — конвейер из шести операций, в котором ИИ работает как компилятор. Только компилирует не код, а знания.

1. Загрузка сырья

Всё начинается с папки raw/, куда складываются источники: статьи из интернета, PDF-файлы, репозитории, скриншоты. Для конвертации веб-статей в markdown Карпати использует расширение Obsidian Web Clipper — один клик, и статья превращается в чистый .md-файл.

2. Компиляция в вики

LLM читает всё содержимое raw/ и инкрементально собирает из него вики — набор .md-файлов с чёткой структурой директорий. Модель сама пишет статьи, расставляет обратные ссылки, группирует данные по концепциям и связывает всё между собой.

3. Масштабирование

Когда вики набирает критическую массу — сотни статей, сотни тысяч слов — она становится мощным субстратом для исследований. У ИИ появляется достаточно контекста, чтобы отвечать на сложные вопросы, которые человек собирал бы часами.

4. Запросы к базе

Теперь можно задавать агенту сложные исследовательские вопросы. Он ходит по ссылкам внутри вики, сопоставляет данные из разных статей и собирает ответ из нескольких источников. По сути — ваш персональный аналитик, у которого в голове вся ваша база.

Важная деталь из idea-файла: хорошие ответы можно сохранять обратно в вики как новые страницы. Сравнительный анализ, неочевидная связь, инсайт — всё это не должно пропадать в истории чата. Так запускается петля компаундинга: источники попадают в вики → запросы генерируют инсайты → лучшие инсайты становятся новыми страницами вики. Знания не просто накапливаются — они множатся.

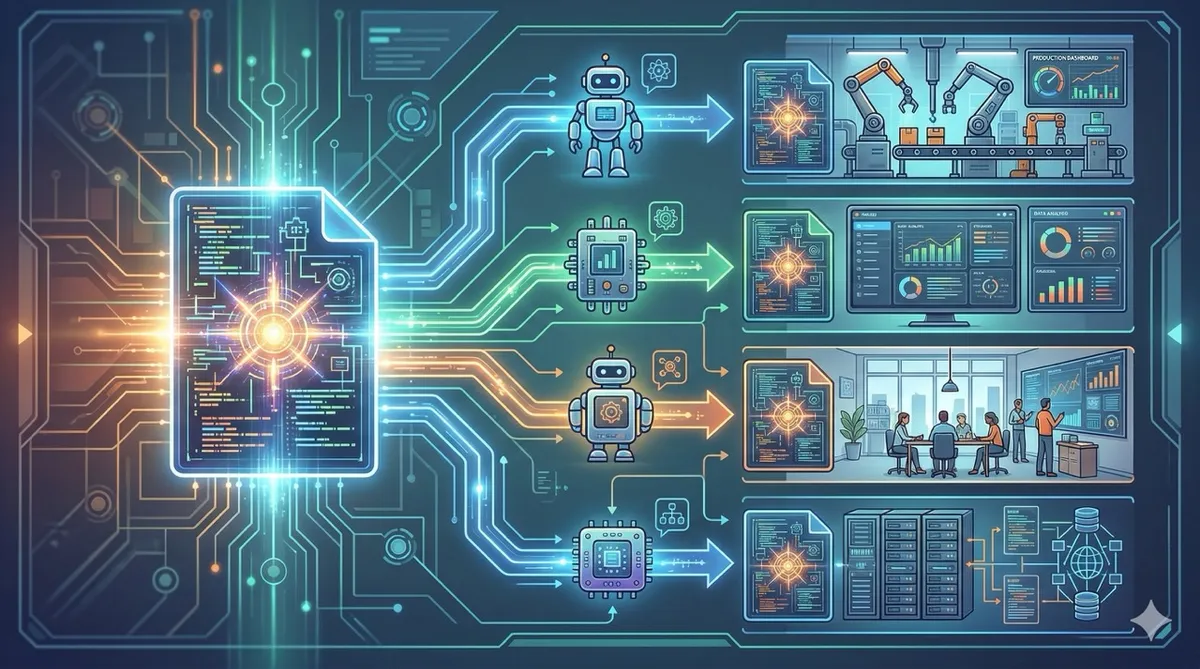

5. Вывод в разных форматах

Результат — это не просто текст в чате. Карпати настроил вывод в нескольких форматах:

- Markdown-файлы — для новых статей вики

- Marp-слайды — для презентаций прямо из markdown

- Matplotlib-графики — для визуализации данных

Всё это он просматривает в Obsidian, который служит фронтендом для всей системы.

6. Проверка здоровья

Отдельная команда запускает «аудит» вики. ИИ ищет противоречия между статьями, заполняет пробелы через веб-поиск, находит неочевидные связи между концепциями и предлагает темы для новых статей. По сути — это тесты для базы знаний, как unit-тесты для кода.

Так это замена RAG?

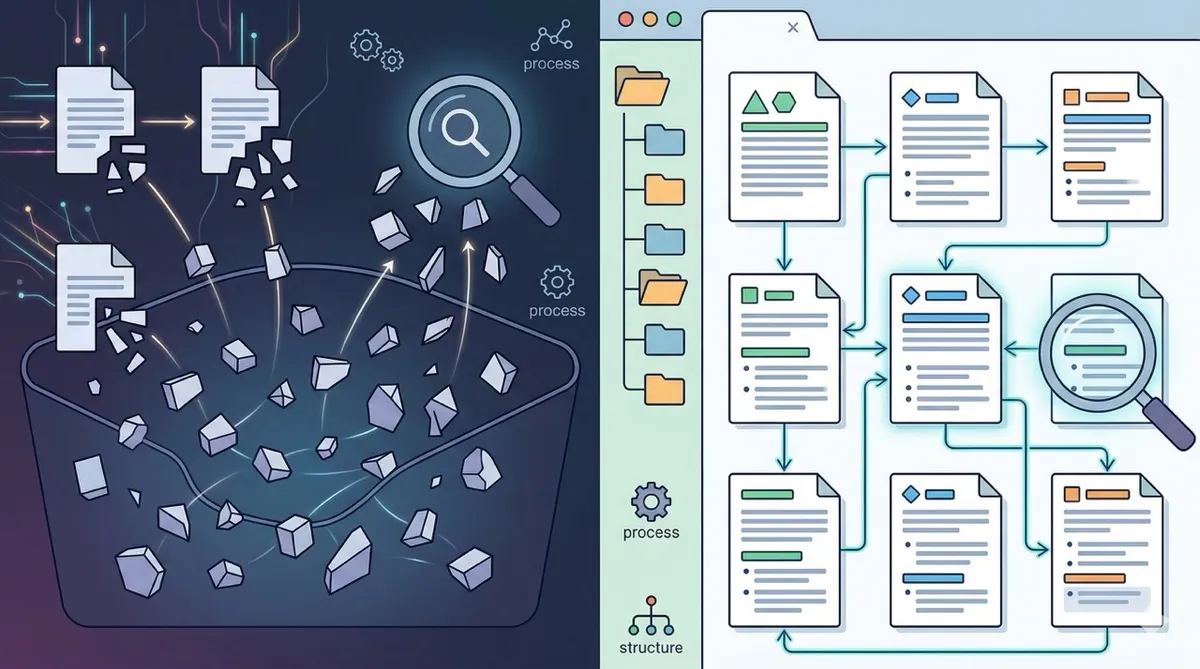

В каком-то смысле — да. Последние три года индустрия строила системы Retrieval-Augmented Generation: нарезка документов на чанки, векторные базы данных, семантический поиск. Карпати предлагает другой подход.

Вместо того чтобы нарезать документы на фрагменты и искать по ним, он даёт ИИ сразу весь контекст в виде структурированной вики. Для средних объёмов данных — десятки и сотни документов — это работает лучше, потому что модель видит связи, которые при chunking теряются.

В idea-файле Карпати формулирует это ещё точнее: «Знания компилируются один раз и поддерживаются в актуальном состоянии, а не пересобираются на каждый запрос». Перекрёстные ссылки уже проставлены. Противоречия уже помечены. Синтез уже отражает всё, что вы когда-либо загружали.

При этом для навигации на умеренных объёмах (~100 источников, сотни страниц) хватает обычного index.md — файла-каталога, который ИИ обновляет при каждой загрузке. Агент читает индекс, находит релевантные страницы и идёт в них напрямую. Без векторных баз, без embeddings, без инфраструктуры. Когда вики разрастётся до сотен страниц, можно подключить qmd — локальный поисковик для markdown-файлов с гибридным BM25/векторным поиском, созданный Тоби Люткe, CEO Shopify.

Это не универсальная замена RAG для терабайтов корпоративных данных. Но для персональных исследований, проектной документации, конкурентной разведки — подход Карпати проще, прозрачнее и не требует инфраструктуры.

Эволюция: от «вайб-кодинга» до «компиляции знаний»

Если посмотреть на траекторию Карпати за последний год, видна чёткая линия:

- Февраль 2025 — придумал «vibe coding»: забудь про код, просто разговаривай с ИИ

- Январь 2026 — «agentic engineering»: человек пишет меньше 1% кода, остальное делают агенты

- Апрель 2026 — «LLM Knowledge Bases»: выходим за пределы кода вообще, ИИ управляет знаниями

Каждый этап расширяет границы. Сначала ИИ генерировал код. Потом — оркестрировал агентов, которые генерируют код. Теперь — управляет знаниями, из которых код — лишь один из возможных выходов.

И всё это работает на markdown. Документы — markdown. Вики — markdown. Инструкции для агентов — markdown. Markdown становится языком программирования эпохи ИИ.

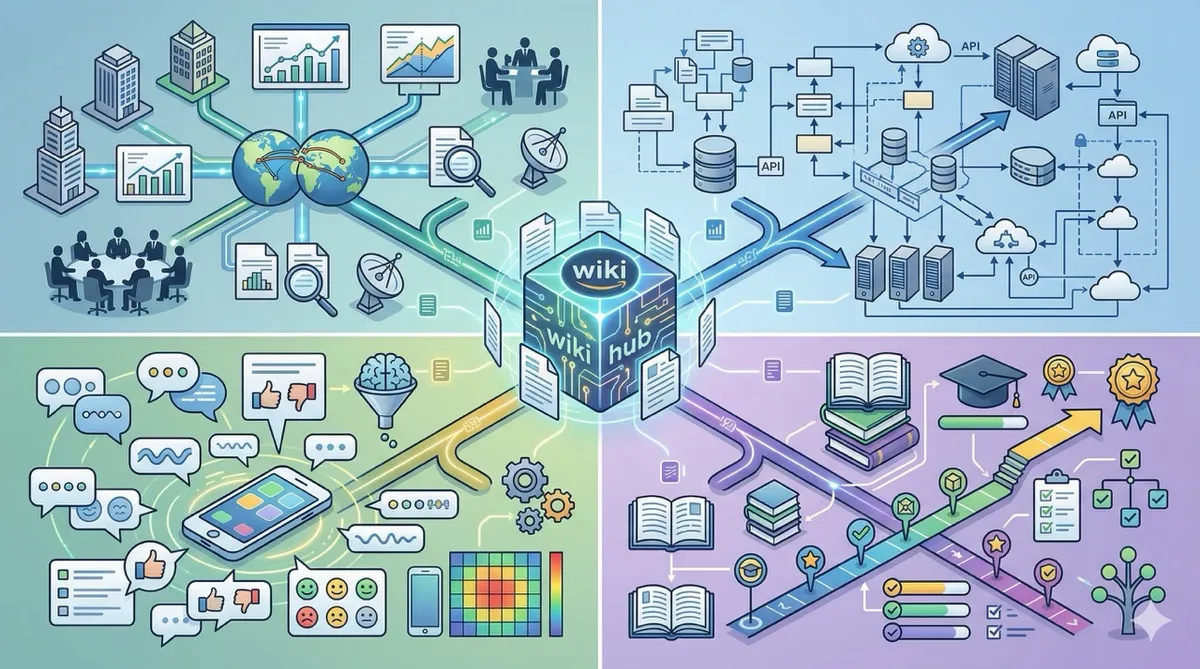

Idea-файлы: новый open source для эпохи агентов

Но самое интересное в follow-up Карпати — даже не техническая архитектура, а формат, в котором он ей поделился.

Он не опубликовал GitHub-репозиторий с кодом. Не выложил npm-пакет. Не создал Docker-образ. Вместо этого он написал «idea file» — структурированное описание паттерна на человеческом языке — и выложил его как GitHub-гист.

Его логика: «В эпоху ИИ-агентов нет большого смысла делиться конкретным кодом или приложением. Вы делитесь идеей — а агент другого человека адаптирует и реализует её под конкретные нужды».

Подумайте, что это значит. Карпати использует Obsidian на macOS с Claude Code. Вы можете использовать VS Code на Linux с OpenAI Codex. Если бы он поделился репозиторием — вам пришлось бы форкать, адаптировать, дебажить. А idea-файл вы просто копируете своему агенту, и тот строит версию под ваш стек.

Гист намеренно написан «немного абстрактно и расплывчато, потому что у этого паттерна слишком много направлений развития». У гиста есть вкладка Discussion, где люди предлагают свои вариации — от .brain-папок в проектах до обмена гистами между разными ИИ-агентами.

Это новый вид open source. Не открытый код — а открытые идеи, спроектированные так, чтобы их интерпретировали и воплощали ИИ-агенты.

Где это применимо уже сейчас

Карпати собрал систему для ML-исследований, но паттерн универсален:

- Конкурентная разведка — загружаете сайты конкурентов, их блоги, вакансии, пресс-релизы. ИИ компилирует профили компаний, матрицы фич и стратегические выводы

- Проектная документация — README, ADR, постмортемы инцидентов. Новый разработчик задаёт вопрос — и получает ответ с контекстом всего проекта

- Продуктовые исследования — отзывы пользователей, запросы фич, результаты интервью. Вики группирует паттерны и помогает приоритизировать

- Личное обучение — складываете всё, что читаете по новой теме. Через пару недель у вас персональный учебник с чёткой структурой

Мемекс 1945 года — и кто делает всю работу

В конце idea-файла Карпати проводит неожиданную параллель. В 1945 году инженер Вэнивар Буш описал гипотетическое устройство «Мемекс» — персональную машину для хранения всех книг, записей и документов с «ассоциативными тропами» между ними. Буш понимал, что человеческое мышление работает через ассоциации, а не через алфавитные каталоги.

Эта идея напрямую вдохновила Дугласа Энгельбарта (создателя компьютерной мыши), Теда Нельсона (автора термина «гипертекст») и Тима Бернерса-Ли (создателя Всемирной паутины). Но веб стал публичным и хаотичным — а Буш представлял себе нечто персональное и курируемое.

LLM Wiki Карпати — это ближе к оригинальной идее Мемекса, чем современный интернет. Частная база, активно курируемая, где связи между документами ценны не меньше самих документов.

А недостающий кусок, который Буш не мог решить в 1945-м? Кто будет делать всю рутинную работу — проставлять ссылки, обновлять связи, поддерживать консистентность? Люди бросают системы управления знаниями, потому что бремя обслуживания растёт быстрее, чем польза.

Карпати пишет: «LLM не устают, не забывают обновить перекрёстную ссылку и могут за один проход затронуть 15 файлов. Вики остаётся актуальной, потому что стоимость обслуживания близка к нулю».

Почему 15 миллионов просмотров

Этот пост взорвался не потому, что Карпати — знаменитость (хотя это помогает). Он попал в нерв: люди устали от разговоров про «ИИ заменит программистов» и хотят видеть конкретные рабочие системы.

Карпати показал не концепцию, а работающий пайплайн. С конкретными инструментами (Obsidian, Web Clipper), конкретными метриками (100 статей, 400K слов) и конкретной философией: ИИ — это не чат-бот для ответов на вопросы, а компилятор, который превращает хаос в структуру.

И это, пожалуй, самый точный способ думать об ИИ в 2026 году. Не «попроси ChatGPT написать текст». А «построй систему, в которой ИИ непрерывно обрабатывает, структурирует и обогащает твои знания».

Разница — как между калькулятором и Excel. Калькулятор считает то, что вы попросили. Excel — это система, которая работает с вашими данными.

Что из этого взять

Не обязательно повторять всю систему Карпати с первого дня. Начните с малого:

- Выберите одну тему, в которой хотите разобраться глубже

- Создайте папку

raw/и соберите в неё 10–15 статей или документов - Напишите простой schema-файл (

CLAUDE.mdилиAGENTS.md) с правилами для вашей вики — структура страниц, формат frontmatter, workflow загрузки - Попросите ИИ-агента скомпилировать из сырья структурированную вики с перекрёстными ссылками

- Задайте вики вопрос, на который ни один отдельный источник не отвечает

- Если ответ оказался ценным — сохраните его как новую страницу вики

Если результат вас удивит — значит, система работает. И дальше она будет только расти.

А если не хотите разбираться с нуля — просто скопируйте idea-файл Карпати и отдайте его своему ИИ-агенту. В этом и весь смысл idea-файлов: агент прочитает описание и соберёт систему под вас.

По теме

- Статья: 12 приёмов, которые превращают ИИ-агента из игрушки в рабочий инструмент

- Блог: n8n встроил MCP-сервер — и теперь ваши ИИ-агенты сами собирают автоматизации

- База знаний: NotebookLM — AI-ассистент Google для работы с документами

Если вы уже строите свои системы работы с ИИ и хотите перейти от разовых запросов к полноценным рабочим контурам — давайте обсудим, как это сделать на практике.