Мой сайт теперь знает, что о нём говорят Яндекс и Google

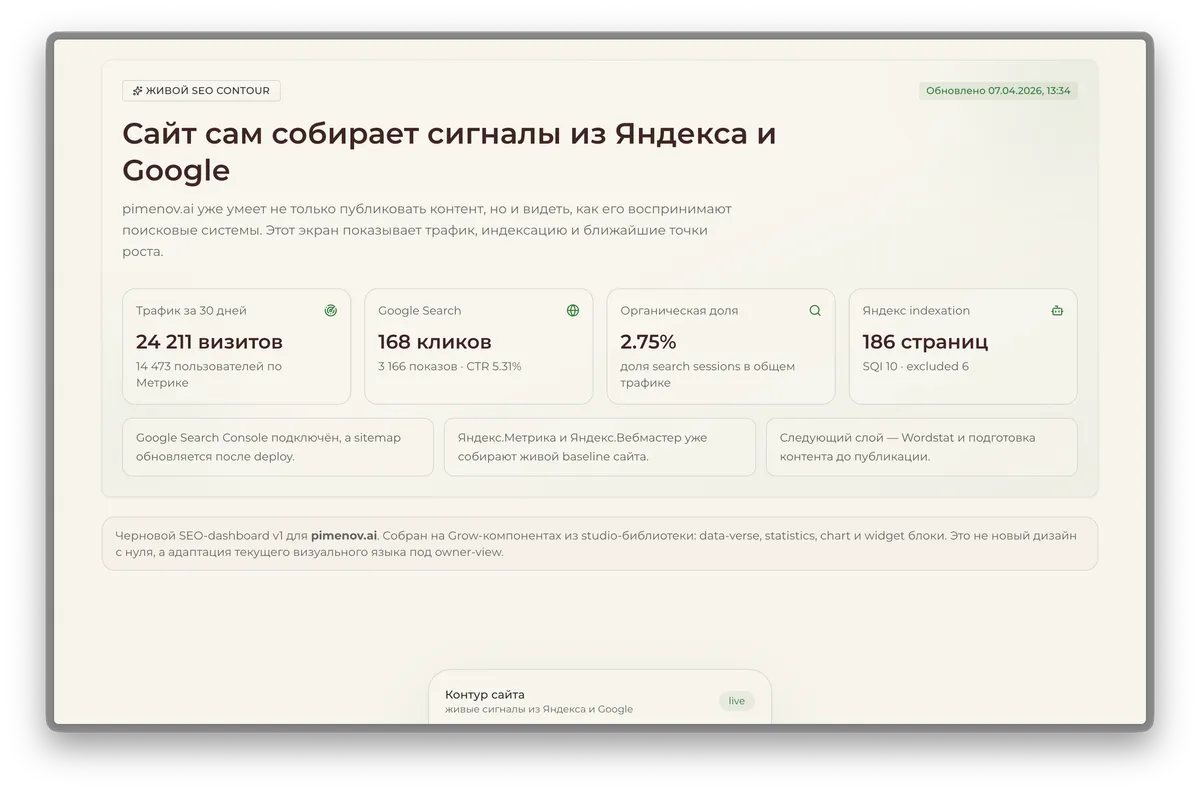

Личный рассказ о том, как мы с моим ИИ-агентом Саркисом подключили pimenov.ai к Яндекс.Метрике, Яндекс.Вебмастеру и Google Search Console, собрали SEO-дашборд и превратили сайт в живую систему, которая умеет видеть собственное состояние и готовится к следующему шагу — Wordstat и осмысленному планированию контента.

Я строю pimenov.ai вместе с агентами. Они помогают мне писать, собирать страницы, обновлять структуру и поддерживать сайт в движении. А теперь мы дошли до следующего состояния: сайт умеет сам получать данные от Яндекса и Google и смотреть на себя не вслепую.

Для меня это важный шаг не потому, что мы "подключили аналитику". А потому, что сайт наконец перестаёт быть статичной витриной и становится живой системой, которая чувствует, что с ней происходит.

В этой истории есть ещё один важный герой. Саркис — это мой ИИ-агент. Он живёт на сервере, работает рядом со мной и помогает не только с кодом, инфраструктурой и интеграциями, но и с тем, как вообще мыслить сайт как систему.

Слепой режим, который мне надоел

Когда делаешь сайт вручную, у тебя почти всегда одна и та же проблема: ты публикуешь материал, обновляешь страницу, выкладываешь новую структуру — а дальше сам идёшь и проверяешь, что вообще изменилось. Есть ли трафик? Что видит поиск? Какие страницы живут? Какие не живут? Где есть сигналы, а где пустота?

Мне это всегда казалось слишком слепым режимом работы. Если я делаю сайт вместе с агентами, то хочется большего. Хочется, чтобы система не только производила контент, но и умела получать обратную связь.

Я сформулировал это для Саркиса довольно просто: «Нам нужно, чтобы сайт не просто публиковал материалы, а понимал, что о нём говорят Яндекс и Google.»

Саркис ответил так, как обычно отвечает хороший инженерный агент: «Тогда делаем не просто счётчик, а внешний контур восприятия вокруг сайта. И делаем его так, чтобы он не ломал сам сайт.»

Это был правильный поворот. Мы не стали превращать фронтенд в склад внешних интеграций. Не стали вшивать поисковые API в рендер страниц. Не стали делать так, чтобы публичный слой зависел от внешних сервисов в каждый момент времени. Вместо этого вокруг сайта появился отдельный аналитико-поисковый контур.

Три слоя наблюдения за один заход

На первом этапе мы собрали сразу три рабочих слоя наблюдения.

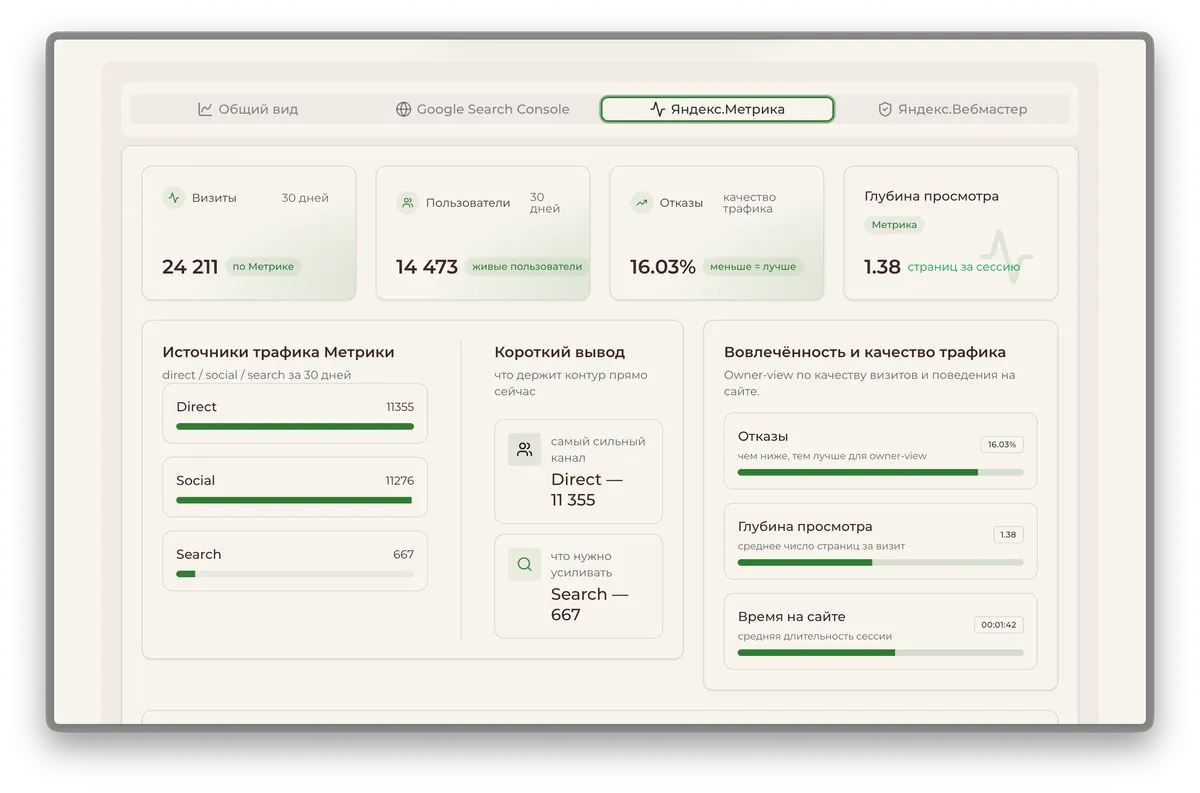

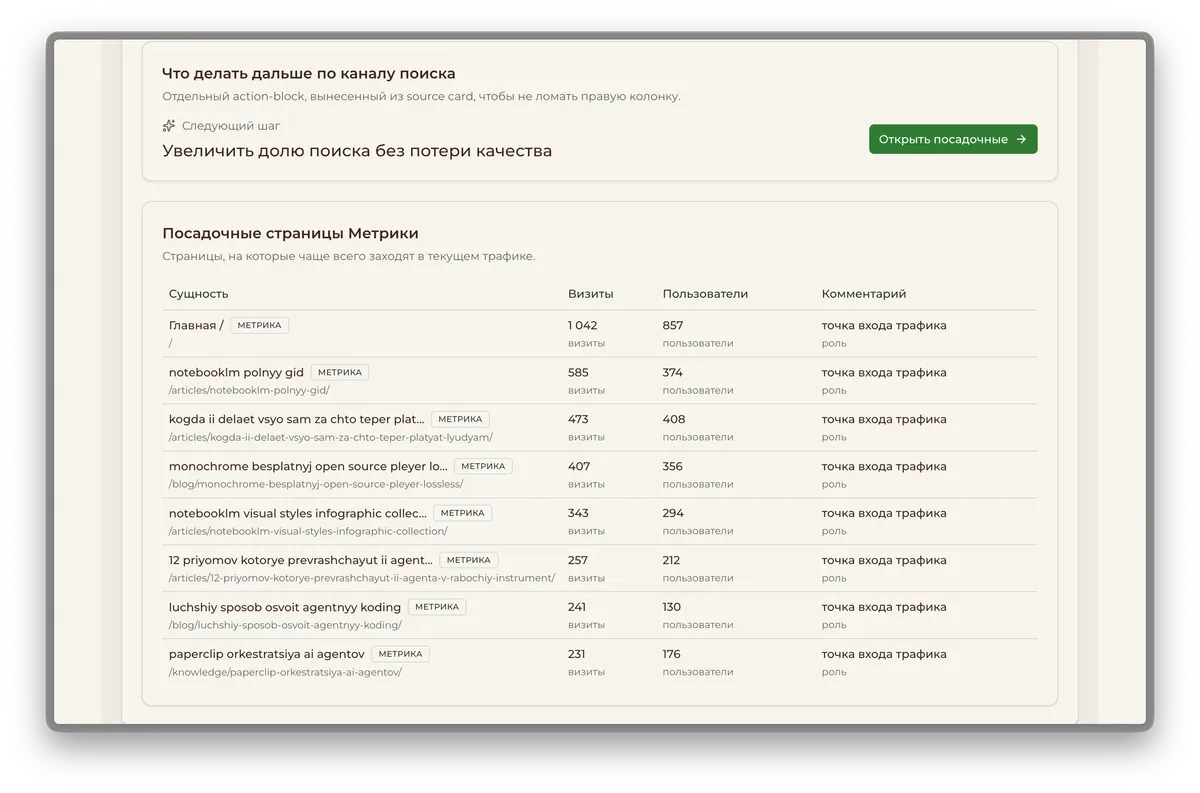

- Яндекс.Метрика — чтобы видеть визиты, пользователей, источники трафика, посадочные страницы, отказы и вовлечённость.

- Яндекс.Вебмастер — чтобы видеть индексируемые страницы, исключения, sitemap, сигналы индексации и поисковые запросы.

- Google Search Console — чтобы видеть клики, показы, CTR, среднюю позицию, топ запросов и топ страниц в Google.

С технической стороны это означало OAuth, токены, API-доступы, read-only контуры, baseline-сборку, post-deploy hooks и отдельный SEO-дашборд. Но по смыслу мы делали не интеграции как таковые. Мы собирали для сайта его первую нервную систему.

Раньше сайт просто существовал. Теперь он ещё и слышит среду вокруг себя. Он может понять, сколько у него реального трафика, какие страницы работают, как его видит Яндекс, как его видит Google, и что меняется после публикации.

Если коротко: сайт научился не только говорить, но и слушать.

Чистый сайт снаружи, нервная система внутри

Сейчас контур устроен так: сам сайт остаётся чистым, а вокруг него живёт отдельная система сбора и обработки сигналов.

- После деплоя автоматически обновляется sitemap.

- Sitemap уходит в Яндекс и в Google.

- Для Яндекса добавлен ещё и переобход изменённых URL.

- Метрика, Вебмастер и Search Console складывают данные в отдельные read-only контуры.

- Поверх этих данных собирается единая summary layer и отдельный SEO-дашборд.

Мне нравится, что это не хрупкая схема. Сайт не зависит от того, ответит ли сейчас внешний API. Публичный слой не завязан на поисковые сервисы. Но при этом вся система уже умеет собирать сигналы и возвращать их обратно в рабочий контур.

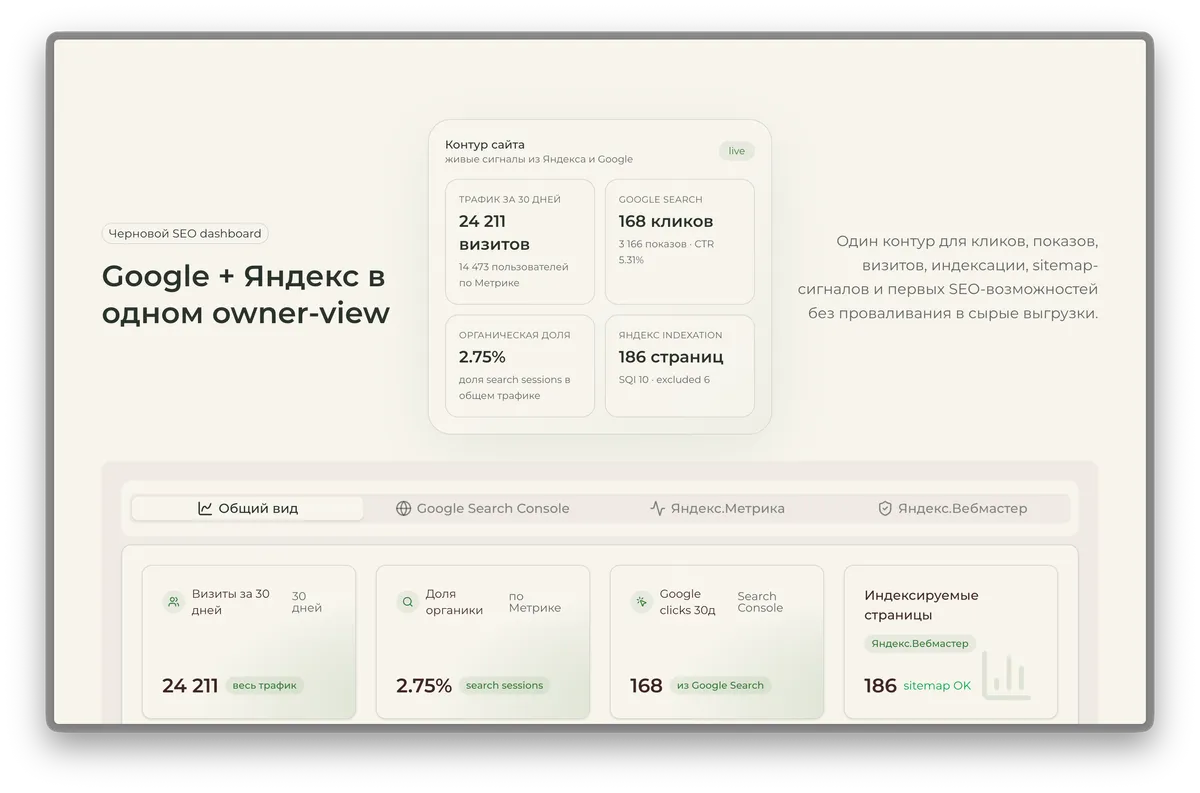

Дашборд, который вырос из самого проекта

Отдельно мы вынесли всё это в SEO-дашборд. Причём принципиально не стали рисовать новый интерфейс с нуля. Мы использовали тот визуальный язык, который уже живёт внутри проекта, и собрали из него новую поверхность для наблюдения.

Это тоже часть моей общей идеи: если сайт живой и в нём живут агенты, то он не должен бесконечно плодить несвязанные сущности. Он должен расти из уже существующих паттернов. Поэтому и дашборд мы собирали не как "ещё один отдельный продукт", а как естественное продолжение самой системы.

Конечно, без накладок не обошлось. Где-то поехала вёрстка, где-то пришлось изолировать route, где-то нужно было отделить dashboard-only компоненты от shared preview surfaces. Но в этом как раз и есть реальная совместная работа: пробуем, ошибаемся, чиним, наводим порядок, делаем контур чище.

Что pimenov.ai уже умеет прямо сейчас

Если говорить простым языком, а не языком интеграций, то сейчас pimenov.ai уже умеет довольно много.

- Понимать, сколько у него реального трафика.

- Видеть, откуда этот трафик приходит.

- Видеть, какие страницы реально работают.

- Видеть, как его воспринимает Яндекс.

- Видеть, как его воспринимает Google.

- Автоматически отправлять обновлённый sitemap в поисковые системы.

- После деплоя сигнализировать, что контент изменился.

- Собирать всё это в единый контур наблюдения и сводки.

То есть сайт больше не публикует страницы в пустоту. Он публикует, получает ответ от среды, сохраняет сигналы и постепенно становится чуть более осознанным.

Следующий уровень — Wordstat и предугадывание спроса

Следующий важный слой — Wordstat. И для меня это, пожалуй, даже интереснее всего.

Потому что сейчас сайт уже умеет видеть сигналы после публикации. Но следующий уровень — научить его лучше ориентироваться ещё до следующего текста. Понимать, какие запросы уже живут в поиске, как люди формулируют интерес, где есть реальный спрос, а где только ощущение, что тема "должна быть важной".

Когда мы подключим Wordstat-контур, система получит ещё один тип зрения: не только рефлексию после публикации, но и ориентацию до публикации. И это уже совсем другой уровень контентной работы.

Я сказал Саркису: «Сначала мы научили сайт смотреть на себя. Теперь надо научить его лучше смотреть вперёд.»

И он ответил ровно в ту же логику: «Тогда следующим слоем будет не просто аналитика, а подготовка к следующему контентному решению.»

Это не про аналитику — это про эволюцию

Больше всего мне нравится не технический факт подключения Метрики или Search Console. Главный смысл для меня в другом. Сайт постепенно перестаёт быть "папкой со страницами" и становится средой, где уже живут агенты.

Агенты пишут контент. Агенты помогают собирать страницы. Агенты обновляют сайт. А теперь агенты помогают сайту понимать, что с ним происходит. И это уже очень близко к тому, как я вообще вижу интернет-проекты будущего: не как витрины, а как живые системы, в которых человек и агенты работают вместе.

Именно поэтому вся эта история для меня не про "аналитику". Она про эволюцию самого сайта.

Вместо финала

Сейчас pimenov.ai — это уже не просто сайт, который я делаю вместе с агентами. Это сайт, который собирается вместе с агентами, обновляется вместе с агентами, публикует вместе с агентами и теперь ещё учится понимать, что о нём говорят Яндекс и Google.

Следующий шаг — научить его лучше чувствовать поисковый спрос до следующей публикации. То есть добавить Wordstat и превратить этот контур не просто в систему наблюдения, а в систему более умного контентного движения.

Сначала мы научили сайт говорить. Потом — обновляться. Теперь мы учим его слушать. А дальше будем учить его предугадывать.

По теме

- Статья: Как сайт становится живым контуром: человек, агент, Notion и live-сайт

- Блог: NeuralDeep Skills — российский каталог навыков для ИИ-агентов, которого давно не хватало

- База знаний: Programmatic SEO — методология масштабного создания контента

Если вы строите сайт вместе с ИИ-агентами и хотите разобраться, как превратить его из статичной витрины в живую систему с обратной связью — давайте обсудим.